LLMs之MiniCPM:MiniCPM(揭示端侧大语言模型的无限潜力)的简介、安装和使用方法、案例应用之详细攻略

目录

MiniCPM的简介

0、更新日志

1、公开的模型

2、局限性

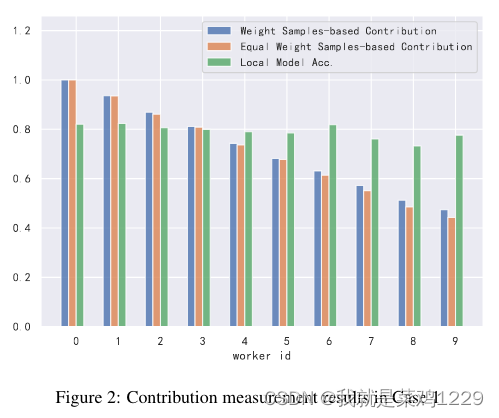

3、文本模型评测

越级比较:

同级比较:

Chat模型比较:

DPO后模型比较:

MiniCPM-2B-128k 模型评测

MiniCPM-MoE-8x2B模型评测

多模态模型评测

MiniCPM的安装和使用方法

1、 模型下载

语言模型

多模态模型

2、模型推理

T1、Huggingface 模型

MiniCPM-2B

MiniCPM-2B (Llama Format)

MiniCPM-V

T2、vLLM 推理

安装vLLM

测试样例

期望输出

T3、llama.cpp、Ollama、fastllm、mlx_lm推理

llama.cpp

ollama

fastllm

mlx_lm

3、模型部署

手机部署

部署步骤

部署性能

Demo & API 部署

基于Gradio的网页版Demo

MiniCPM的案例应用

MiniCPM的简介

MiniCPM 是面壁智能与清华大学自然语言处理实验室共同开源的系列端侧大模型,主体语言模型 MiniCPM-2B 仅有 24亿(2.4B)的非词嵌入参数量, 总计2.7B参数量。

- 经过 SFT 后,MiniCPM-2B 在公开综合性评测集上与 Mistral-7B 表现相近(中文、数学、代码能力更优),整体性能超越 Llama2-13B、MPT-30B、Falcon-40B 等模型。

- 经过 DPO 后,MiniCPM-2B 在当前最接近用户体感的评测集 MTBench 上也超越了 Llama2-70B-Chat、Vicuna-33B、Mistral-7B-Instruct-v0.1、Zephyr-7B-alpha 等众多代表性开源大模型。

- 以 MiniCPM-2B 为基础构建端侧多模态大模型 MiniCPM-V 2.0,在多个测试基准中实现了 7B 以下模型的最佳性能,在 OpenCompass 榜单上超过了 Qwen-VL-Chat 9.6B、CogVLM-Chat 17.4B 和 Yi-VL 34B 等更大参数规模的模型。MiniCPM-V 2.0 还展现出领先的 OCR 能力,在场景文字识别能力上接近 Gemini Pro。

- 经过 Int4 量化后,MiniCPM 可在手机上进行部署推理,流式输出速度略高于人类说话速度。MiniCPM-V 也直接跑通了多模态大模型在手机上的部署。

- 一张1080/2080可高效参数微调,一张3090/4090可全参数微调,一台机器可持续训练 MiniCPM,二次开发成本较低。

GitHub地址:GitHub - OpenBMB/MiniCPM: MiniCPM-2B: An end-side LLM outperforms Llama2-13B.

0、更新日志

- 2024/04/11 开源MiniCPM-V-2.0、MiniCPM-2B-128k、MiniCPM-MoE-8x2B和MiniCPM-1B!点击这里查看技术博客。

- 2024/03/16 MiniCPM-2B 的30余个中间检查点开放了!HuggingFace链接

- 2024/02/13 支持了llama.cpp

- 2024/02/09 我们在README里加入了一个开源社区章节,用来收集开源社区对MiniCPM的支持案例。

- 2024/02/08 我们更新了llama-format的模型权重,方便大家更加快捷地使用我们的模型。

- 2024/02/01 初始发布。

1、公开的模型

我们完全开源MiniCPM系列的模型参数供学术研究和有限商用。 具体而言,我们目前已公开以下模型,地址详见 模型下载 部分

- 基于MiniCPM-2B的指令微调与人类偏好对齐版本MiniCPM-2B-SFT/DPO。

- 基于MiniCPM-2B的多模态模型MiniCPM-V 2.0。

- MiniCPM-2B-SFT/DPO的Int4量化版MiniCPM-2B-SFT/DPO-Int4。

- MiniCPM-2B的128k长文本版本MiniCPM-2B-128k。

- MiniCPM-2B的MoE版本MiniCPM-MoE-8x2B。

- 更轻量级的MiniCPM-1B指令微调版本MiniCPM-1B-SFT。

- 基于MLC-LLM、LLMFarm开发的MiniCPM手机端程序,文本及多模态模型均可在手机端进行推理。

- MiniCPM-2B训练过程中的30个Checkpoints供模型机理研究。

2、局限性

- 受限于模型规模,模型可能出现幻觉性问题。其中由于DPO模型生成的回复内容更长,更容易出现幻觉。我们也将持续进行MiniCPM模型的迭代改进。

- 为了保证在学术研究用途上模型的通用性,我们未对模型进行任何身份认同训练。同时由于我们用ShareGPT开源语料作为部分训练数据,模型可能会输出类似GPT系列模型的身份认同信息。

- 受限于模型规模,模型的输出受到提示词(prompt)的影响较大,可能多次尝试产生不一致的结果。

- 受限于模型容量,模型的知识记忆较不准确,后续我们将结合RAG方法来增强模型的知识记忆能力。

3、文本模型评测

越级比较:

| 模型 | 平均分 | 英文均分 | 中文均分 | C-Eval | CMMLU | MMLU | HumanEval | MBPP | GSM8K | MATH | BBH | ARC-E | ARC-C | HellaSwag |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Llama2-7B | 35.40 | 36.21 | 31.765 | 32.42 | 31.11 | 44.32 | 12.2 | 27.17 | 13.57 | 1.8 | 33.23 | 75.25 | 42.75 | 75.62* |

| Qwen-7B | 49.46 | 47.19 | 59.655 | 58.96 | 60.35 | 57.65 | 17.07 | 42.15 | 41.24 | 5.34 | 37.75 | 83.42 | 64.76 | 75.32* |

| Deepseek-7B | 39.96 | 39.15 | 43.64 | 42.82 | 44.45 | 47.82 | 20.12 | 41.45 | 15.85 | 1.53 | 33.38 | 74.58* | 42.15* | 75.45* |

| Mistral-7B | 48.97 | 49.96 | 44.54 | 46.12 | 42.96 | 62.69 | 27.44 | 45.2 | 33.13 | 5.0 | 41.06 | 83.92 | 70.73 | 80.43* |

| Llama2-13B | 41.48 | 42.44 | 37.19 | 37.32 | 37.06 | 54.71 | 17.07 | 32.55 | 21.15 | 2.25 | 37.92 | 78.87* | 58.19 | 79.23* |

| MPT-30B | 38.17 | 39.82 | 30.72 | 29.34 | 32.09 | 46.56 | 21.95 | 35.36 | 10.31 | 1.56 | 38.22 | 78.66* | 46.08* | 79.72* |

| Falcon-40B | 43.62 | 44.21 | 40.93 | 40.29 | 41.57 | 53.53 | 24.39 | 36.53 | 22.44 | 1.92 | 36.24 | 81.94* | 57.68 | 83.26* |

| MiniCPM-2B | 52.33 | 52.6 | 51.1 | 51.13 | 51.07 | 53.46 | 50.00 | 47.31 | 53.83 | 10.24 | 36.87 | 85.44 | 68.00 | 68.25 |

同级比较:

| 模型 | 平均分 | 英文均分 | 中文均分 | C-Eval | CMMLU | MMLU | HumanEval | MBPP | GSM8K | MATH | BBH | ARC-E | ARC-C | HellaSwag |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| TinyLlama-1.1B | 25.36 | 25.55 | 24.525 | 25.02 | 24.03 | 24.3 | 6.71 | 19.91 | 2.27 | 0.74 | 28.78 | 60.77* | 28.15* | 58.33* |

| Qwen-1.8B | 34.72 | 31.87 | 47.57 | 49.81 | 45.32 | 43.37 | 7.93 | 17.80 | 19.26 | 2.42 | 29.07 | 63.97* | 43.69 | 59.28* |

| Gemini Nano-3B | - | - | - | - | - | - | - | 27.2(report) | 22.8(report) | - | 42.4(report) | - | - | - |

| StableLM-Zephyr-3B | 43.46 | 46.31 | 30.62 | 30.34 | 30.89 | 45.9 | 35.37 | 31.85 | 52.54 | 12.49 | 37.68 | 73.78 | 55.38 | 71.87* |

| Phi-2-2B | 48.84 | 54.41 | 23.78 | 23.37 | 24.18 | 52.66 | 47.56 | 55.04 | 57.16 | 3.5 | 43.39 | 86.11 | 71.25 | 73.07* |

| MiniCPM-2B | 52.33 | 52.6 | 51.10 | 51.13 | 51.07 | 53.46 | 50.00 | 47.31 | 53.83 | 10.24 | 36.87 | 85.44 | 68.00 | 68.25 |

Chat模型比较:

| 模型 | 平均分 | 英文均分 | 中文均分 | C-Eval | CMMLU | MMLU | HumanEval | MBPP | GSM8K | MATH | BBH | ARC-E | ARC-C | HellaSwag |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| ChatGLM2-6B | 37.98 | 35.17 | 50.63 | 52.05 | 49.21 | 45.77 | 10.37 | 9.38 | 22.74 | 5.96 | 32.6 | 74.45 | 56.82 | 58.48* |

| Mistral-7B-Instruct-v0.1 | 44.36 | 45.89 | 37.51 | 38.06 | 36.96 | 53.56 | 29.27 | 39.34 | 28.73 | 3.48 | 39.52 | 81.61 | 63.99 | 73.47* |

| Mistral-7B-Instruct-v0.2 | 50.91 | 52.83 | 42.235 | 42.55 | 41.92 | 60.51 | 36.59 | 48.95 | 40.49 | 4.95 | 39.81 | 86.28 | 73.38 | 84.55* |

| Qwen-7B-Chat | 44.93 | 42.05 | 57.9 | 58.57 | 57.23 | 56.03 | 15.85 | 40.52 | 42.23 | 8.3 | 37.34 | 64.44* | 39.25* | 74.52* |

| Yi-6B-Chat | 50.46 | 45.89 | 70.995 | 70.88 | 71.11 | 62.95 | 14.02 | 28.34 | 36.54 | 3.88 | 37.43 | 84.89 | 70.39 | 74.6* |

| Baichuan2-7B-Chat | 44.68 | 42.74 | 53.39 | 53.28 | 53.5 | 53 | 21.34 | 32.32 | 25.25 | 6.32 | 37.46 | 79.63 | 60.15 | 69.23* |

| Deepseek-7B-chat | 49.34 | 49.56 | 48.335 | 46.95 | 49.72 | 51.67 | 40.85 | 48.48 | 48.52 | 4.26 | 35.7 | 76.85 | 63.05 | 76.68* |

| Llama2-7B-Chat | 38.16 | 39.17 | 33.59 | 34.54 | 32.64 | 47.64 | 14.02 | 27.4 | 21.15 | 2.08 | 35.54 | 74.28 | 54.78 | 75.65* |

| MiniCPM-2B | 52.33 | 52.6 | 51.10 | 51.13 | 51.07 | 53.46 | 50.00 | 47.31 | 53.83 | 10.24 | 36.87 | 85.44 | 68.00 | 68.25 |

DPO后模型比较:

| 模型 | MT-bench |

|---|---|

| GPT-4-turbo | 9.32 |

| GPT-3.5-turbo | 8.39 |

| Mistral-8*7b-Instruct-v0.1 | 8.30 |

| Claude-2.1 | 8.18 |

| Zephyr-7B-beta | 7.34 |

| MiniCPM-2B | 7.25 |

| Vicuna-33B | 7.12 |

| Zephyr-7B-alpha | 6.88 |

| LLaMA-2-70B-chat | 6.86 |

| Mistral-7B-Instruct-v0.1 | 6.84 |

| MPT-34B-instruct | 6.39 |

MiniCPM-2B-128k 模型评测

| Model | avg | avg w/o code&math | passkey | number_string | kv_retrieval | longbook_choice_eng | longbook_qa_chn | longbook_qa_eng | longbook_sum_eng | longdialogue_qa_eng | math_calc | math_find | code_debug | code_run |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| LWM-Text-128k | 24.45 | 33.62 | 100 | 97.8 | 0.6 | 28.82 | 15.93 | 14.31 | 9.99 | 1.5 | 0 | 3.43 | 20.05 | 1 |

| Yarn-Mistral-7b-128k | 19.84 | 27.36 | 92.71 | 0 | 27.95 | 15.49 | 9.55 | 9.06 | 7.5 | 0 | 17.14 | 0.76 | 1.25 | |

| Mistral-7B-Instruct-v0.2(ABF 1000w) | 27.75 | 36.9 | 100 | 78.98 | 3.6 | 37.12 | 11.74 | 17.37 | 21.12 | 9.5 | 0 | 29.43 | 17.51 | 0 |

| Yi-6B-200k | 22.15 | 32.54 | 100 | 94.92 | 0 | 36.68 | 15.07 | 9.2 | 0.92 | 3.5 | 0 | 4.29 | 0.51 | 0.75 |

| chatglm3-6b-128k | 25.58 | 36.57 | 89.93 | 99.66 | 5.2 | 46.29 | 10.7 | 8.38 | 25.91 | 6.5 | 0 | 8 | 5.33 | 1 |

| MiniCPM-2.4B-128k | 27.32 | 37.68 | 98.31 | 99.83 | 9 | 29.69 | 23.06 | 16.33 | 15.73 | 9.5 | 0 | 4.29 | 22.08 | 0 |

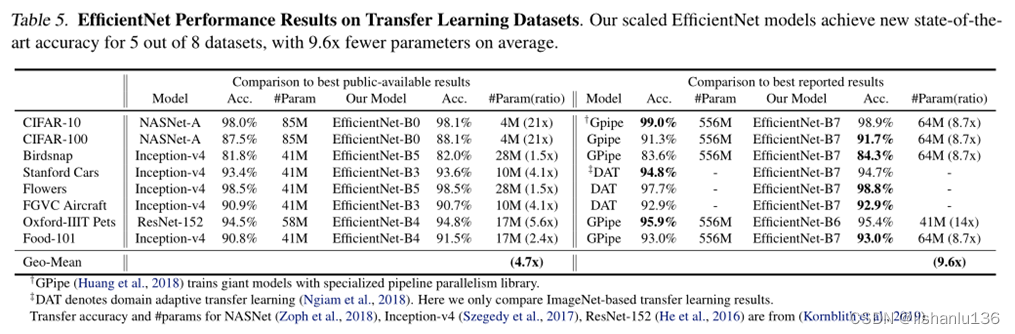

MiniCPM-MoE-8x2B模型评测

| Model | BBH | MMLU | CEval | CMMLU | HumanEval | MBPP† | GSM8K | MATH |

|---|---|---|---|---|---|---|---|---|

| Llama2-34B* | 44.1 | 62.6 | - | - | 22.6 | 33.0 | 42.2 | 6.24 |

| Mistral-7B-Instruct-v0.2 | 39.81 | 60.51 | 42.55 | 41.92 | 36.59 | 39.63 | 40.49 | 4.95 |

| Gemma-7B* | 55.1 | 64.3 | - | - | 32.3 | 44.4 | 46.4 | 24.3 |

| Qwen1.5-7B* | 40.2 | 61 | 74.1 | 73.1 | 36 | 37.4 | 62.5 | 20.3 |

| Deepseek-MoE(16B)* | - | 45.0 | 40.6 | 42.5 | 26.8 | 39.2 | 18.8 | 4.3 |

| MiniCPM-2.4B | 36.87 | 53.46 | 51.13 | 51.07 | 50.00 | 35.93 | 53.83 | 10.24 |

| MiniCPM-MoE-8x2B | 39.22 | 58.90 | 58.11 | 58.80 | 55.49 | 41.68 | 61.56 | 10.52 |

注:* 表示结果取自技术报告。† 表示评测集为MBPP全集。

多模态模型评测

| Model | Size | TextVQA val | DocVQA test | OCRBench | OpenCompass | MME | MMB dev(en) | MMB dev(zh) | MMMU val | MathVista | LLaVA Bench | Object HalBench |

|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Proprietary models | ||||||||||||

| Gemini Pro Vision | - | 74.6 | 88.1 | 680 | 63.8 | 2148.9 | 75.2 | 74.0 | 48.9 | 45.8 | 79.9 | - |

| GPT-4V | - | 78.0 | 88.4 | 645 | 63.2 | 1771.5 | 75.1 | 75.0 | 53.8 | 47.8 | 93.1 | 86.4 / 92.7 |

| Open-source models 6B~34B | ||||||||||||

| Yi-VL-6B | 6.7B | 45.5* | 17.1* | 290 | 49.3 | 1915.1 | 68.6 | 68.3 | 40.3 | 28.8 | 51.9 | - |

| Qwen-VL-Chat | 9.6B | 61.5 | 62.6 | 488 | 52.1 | 1860.0 | 60.6 | 56.7 | 37.0 | 33.8 | 67.7 | 56.2 / 80.0 |

| Yi-VL-34B | 34B | 43.4* | 16.9* | 290 | 52.6 | 2050.2 | 71.1 | 71.4 | 45.1 | 30.7 | 62.3 | - |

| DeepSeek-VL-7B | 7.3B | 64.7* | 47.0* | 435 | 55.6 | 1765.4 | 74.1 | 72.8 | 38.3 | 36.8 | 77.8 | - |

| TextMonkey | 9.7B | 64.3 | 66.7 | 558 | - | - | - | - | - | - | - | - |

| CogVLM-Chat | 17.4B | 70.4 | 33.3* | 590 | 52.5 | 1736.6 | 63.7 | 53.8 | 37.3 | 34.7 | 73.9 | 73.6 / 87.4 |

| Open-source models 1B~3B | ||||||||||||

| DeepSeek-VL-1.3B | 1.7B | 58.4* | 37.9* | 413 | 46.0 | 1531.6 | 64.0 | 61.2 | 33.8 | 29.4 | 51.1 | - |

| MobileVLM V2 | 3.1B | 57.5 | 19.4* | - | - | 1440.5(P) | 63.2 | - | - | - | - | - |

| Mini-Gemini | 2.2B | 56.2 | 34.2* | - | - | 1653.0 | 59.8 | - | 31.7 | - | - | - |

| MiniCPM-V | 2.8B | 60.6 | 38.2 | 366 | 47.6 | 1650.2 | 67.9 | 65.3 | 38.3 | 28.9 | 51.3 | 78.4 / 88.5 |

| MiniCPM-V 2.0 | 2.8B | 74.1 | 71.9 | 605 | 55.0 | 1808.6 | 69.6 | 68.1 | 38.2 | 38.7 | 69.2 | 85.5 / 92.2 |

* 我们自己评测了正式开源的模型权重。

MiniCPM的安装和使用方法

1、 模型下载

语言模型

| HuggingFace | ModelScope | WiseModel |

|---|---|---|

| MiniCPM-2B-sft-bf16 | MiniCPM-2B-sft-bf16 | MiniCPM-2B-sft-bf16 |

| MiniCPM-2B-dpo-bf16 | MiniCPM-2B-dpo-bf16 | MiniCPM-2B-dpo-bf16 |

| MiniCPM-2B-128k | MiniCPM-2B-128k | |

| MiniCPM-MoE-8x2B | MiniCPM-MoE-8x2B | |

| MiniCPM-1B-sft-bf16 | MiniCPM-1B-sft-bf16 |

注: 更多模型版本见这里。

多模态模型

| HuggingFace | ModelScope | WiseModel |

|---|---|---|

| MiniCPM-V 2.0 | MiniCPM-V 2.0 | |

| MiniCPM-V | MiniCPM-V | MiniCPM-V |

| OmniLMM-12B | OmniLMM-12B | OmniLMM-12B |

2、模型推理

在线colab体验地址:https://colab.research.google.com/drive/1tJcfPyWGWA5HezO7GKLeyeIso0HyOc0l?usp=sharing

T1、Huggingface 模型

MiniCPM-2B

- 安装

transformers>=4.36.0以及accelerate后,运行以下代码

from transformers import AutoModelForCausalLM, AutoTokenizer

import torch

torch.manual_seed(0)

path = 'openbmb/MiniCPM-2B-dpo-bf16'

tokenizer = AutoTokenizer.from_pretrained(path)

model = AutoModelForCausalLM.from_pretrained(path, torch_dtype=torch.bfloat16, device_map='cuda', trust_remote_code=True)

responds, history = model.chat(tokenizer, "山东省最高的山是哪座山, 它比黄山高还是矮?差距多少?", temperature=0.5, top_p=0.8, repetition_penalty=1.02)

print(responds)期望输出

山东省最高的山是泰山,海拔1545米。 相对于黄山(海拔1864米),泰山海拔较低,相差约319米。

MiniCPM-2B (Llama Format)

我们将MiniCPM的模型权重转化成了Llama代码可以直接调用的格式,以便大家尝试:

import torch

from transformers import LlamaTokenizerFast, LlamaForCausalLM

model_path = "openbmb/MiniCPM-2B-dpo-bf16-llama-format"

tokenizer = LlamaTokenizerFast.from_pretrained(model_path)

model = LlamaForCausalLM.from_pretrained(model_path, torch_dtype=torch.bfloat16, device_map='cuda', trust_remote_code=True)

prompt="Now you act like a terminal situated within a beginner's C++ practice repository folder, please provide the output for the command: `ls -l`"

input_ids = tokenizer.encode("<用户>{}<AI>".format(prompt), return_tensors='pt', add_special_tokens=True).cuda()

responds = model.generate(input_ids, temperature=0.3, top_p=0.8, repetition_penalty=1.02, max_length=1024)

responds = tokenizer.decode(responds[0], skip_special_tokens=True)

print(responds)MiniCPM-V

import torch

from PIL import Image

from transformers import AutoModel, AutoTokenizer

model = AutoModel.from_pretrained('openbmb/MiniCPM-V', trust_remote_code=True)

tokenizer = AutoTokenizer.from_pretrained('openbmb/MiniCPM-V', trust_remote_code=True)

model.eval().cuda()

image = Image.open('xx.jpg').convert('RGB')

question = 'What is in the image?'

msgs = [{'role': 'user', 'content': question}]

res, context, _ = model.chat(

image=image,

msgs=msgs,

context=None,

tokenizer=tokenizer,

sampling=True,

temperature=0.7

)

print(res)T2、vLLM 推理

安装vLLM

pip install "vllm>=0.4.1"测试样例

python inference/inference_vllm.py --model_path <hf_repo_path> --prompt_path prompts/prompt_demo.txt期望输出

<用户>: Which city is the capital of China?

<AI>:

The capital city of China is Beijing. Beijing is a major political, cultural, and economic center in China, and it is known for its rich history, beautiful architecture, and vibrant nightlife. It is also home to many of China's most important cultural and historical sites, including the Forbidden City, the Great Wall of China, and the Temple of Heaven. Beijing is a popular destination for tourists from around the world, and it is an important hub for international business and trade.T3、llama.cpp、Ollama、fastllm、mlx_lm推理

MiniCPM支持llama.cpp 、ollama、fastllm、mlx_lm推理。感谢@runfuture对llama.cpp和ollama的适配。

llama.cpp

- 安装llama.cpp

- 下载gguf形式的模型。下载链接-fp16格式 下载链接-q4km格式

- 在命令行运行示例代码:

./main -m ../../model_ckpts/download_from_hf/MiniCPM-2B-dpo-fp16-gguf.gguf --prompt "<用户>写藏头诗,藏头是龙年大吉<AI>" --temp 0.3 --top-p 0.8 --repeat-penalty 1.05

更多参数调整详见

ollama

- 安装ollama

- 在命令行运行:

ollama run modelbest/minicpm-2b-dpo

fastllm

import torch

from transformers import AutoTokenizer, LlamaTokenizerFast, AutoModelForCausalLM

path = 'openbmb/MiniCPM-2B-dpo-fp16'

tokenizer = AutoTokenizer.from_pretrained(path)

model = AutoModelForCausalLM.from_pretrained(path, torch_dtype=torch.float16, device_map='cuda', trust_remote_code=True)

from fastllm_pytools import llm

llm.set_device_map("cpu")

model = llm.from_hf(model, tokenizer, dtype = "float16") # dtype支持 "float16", "int8", "int4"

print(model.response("<用户>山东省最高的山是哪座山, 它比黄山高还是矮?差距多少?<AI>", top_p=0.8, temperature=0.5, repeat_penalty=1.02))- 编译安装fastllm

- 模型推理

mlx_lm

安装mlx_lm库

pip install mlx_lm

下载转换后的模型权重MiniCPM-2B-sft-bf16-llama-format-mlx

模型推理

python -m mlx_lm.generate --model mlx-community/MiniCPM-2B-sft-bf16-llama-format-mlx --prompt "hello, tell me a joke." --trust-remote-code3、模型部署

手机部署

部署步骤

- 进行Int4量化后,MiniCPM只占2GB空间,具备在端侧手机进行模型部署的条件。

- 对于不同的操作系统,我们进行了不同的适配。

- 注意:当前开源框架对手机支持还在完善,并非所有芯片与操作系统版本均能成功运行MLC-LLM或LLMFarm。

- Android、HarmonyOS

- 使用开源框架MLC-LLM进行模型适配。

- 支持文本模型、多模态模型。

- 适用于MiniCPM-2B-SFT-INT4、MiniCPM-2B-DPO-INT4、MiniCPM-V。

- 编译安装MiniCPM指南

- iOS

- 使用开源框架LLMFarm进行模型适配。

- 支持文本模型。

- 适用于MiniCPM-2B-SFT-INT4、MiniCPM-2B-DPO-INT4。

- 编译安装MiniCPM指南

部署性能

- 我们未针对手机推理模型进行深度优化和系统测试,仅验证MiniCPM使用手机芯片进行推理的可行性。我们也欢迎更多开发者进一步调优并更新下面的测试列表,不断提升端侧大模型在手机上的推理性能。

| 手机型号 | 操作系统 | 处理器 | Memory(GB) | 文本吞吐(token/s) |

|---|---|---|---|---|

| OPPO Find N3 | Android 13 | snapdragon 8 Gen2 | 12 | 6.5 |

| Samsung S23 Ultra | Android 14 | snapdragon 8 Gen2 | 12 | 6.4 |

| Meizu M182Q | Android 11 | snapdragon 888Plus | 8 | 3.7 |

| Xiaomi 12 Pro | Android 13 | snapdragon 8 Gen1 | 8+3 | 3.7 |

| Xiaomi Redmi K40 | Android 11 | snapdragon 870 | 8 | 3.5 |

| Oneplus LE 2100 | Android 13 | snapdragon 870 | 12 | 3.5 |

| Oneplus HD1900 | Android 11 | snapdragon 865 | 8 | 3.2 |

| Oneplus HD1900 | Android 11 | snapdragon 855 | 8 | 3.0 |

| Oneplus HD1905 | Android 10 | snapdragon 855 | 8 | 3.0 |

| Oneplus HD1900 | Android 11 | snapdragon 855 | 8 | 3.0 |

| Xiaomi MI 8 | Android 9 | snapdragon 845 | 6 | 2.3 |

| Huawei Nova 11SE | HarmonyOS 4.0.0 | snapdragon 778 | 12 | 1.9 |

| Xiaomi MIX 2 | Android 9 | snapdragon 835 | 6 | 1.3 |

| iPhone 15 Pro | iOS 17.2.1 | A17 pro | 8 | 18.0 |

| iPhone 15 | iOS 17.2.1 | A16 | 6 | 15.0 |

| iPhone 12 Pro | iOS 16.5.1 | A14 | 6 | 5.8 |

| iPhone 12 | iOS 17.2.1 | A14 | 4 | 5.8 |

| iPhone 11 | iOS 16.6 | A13 | 4 | 4.6 |

| Xiaomi Redmi K50 | HyperOS 1.0.2 | MediaTek Dimensity 8100 | 12 | 3.5 |

- 我们也使用MLC-LLM验证了在手机上部署MiniCPM-V系列模型的可行性,能够正常输入输出,但也存在图片处理时间较长的问题,需要进一步优化,兼容性问题也需要进一步解决。下面的动图是使用小米14 Pro运行MiniCPM-V 2.0的屏幕录像,没有进行任何编辑。

Demo & API 部署

基于Gradio的网页版Demo

- 使用如下命令启动基于Gradio的网页版demo:

# generation powered by vllm

python demo/vllm_based_demo.py --model_path <vllmcpm_repo_path>

# generation powered by huggingface

python demo/hf_based_demo.py --model_path <hf_repo_path>MiniCPM的案例应用

持续更新中……

![【阿里笔试题汇总】[全网首发] 2024-04-29-阿里国际春招笔试题-三语言题解(CPP/Python/Java)](https://img-blog.csdnimg.cn/direct/274440ba75ee462aa6a003a129bbcefd.png#pic_center)